Google Gemma 4 正式开源:Apache 2.0 协议、手机端可运行、原生支持多模态和 Agent 工作流

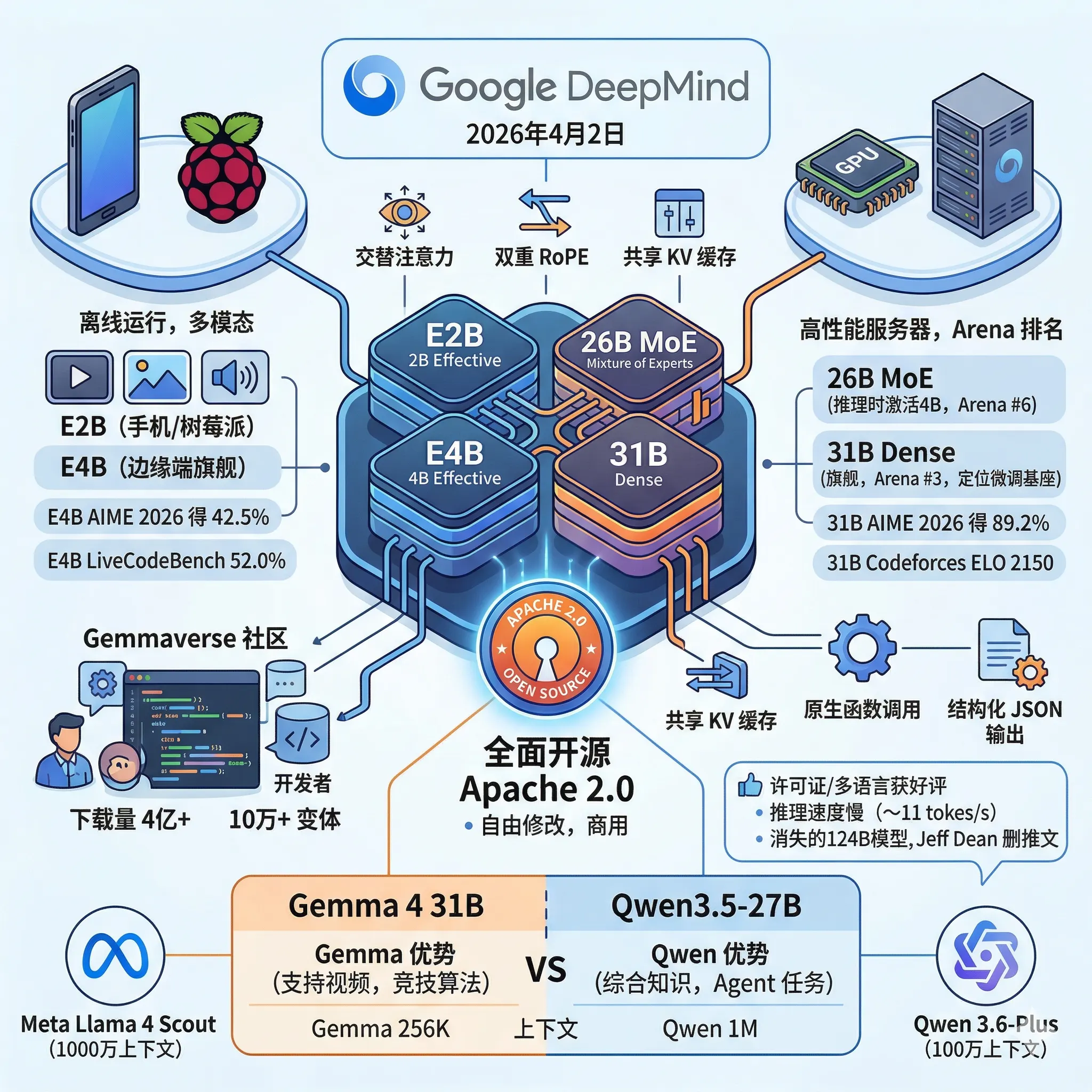

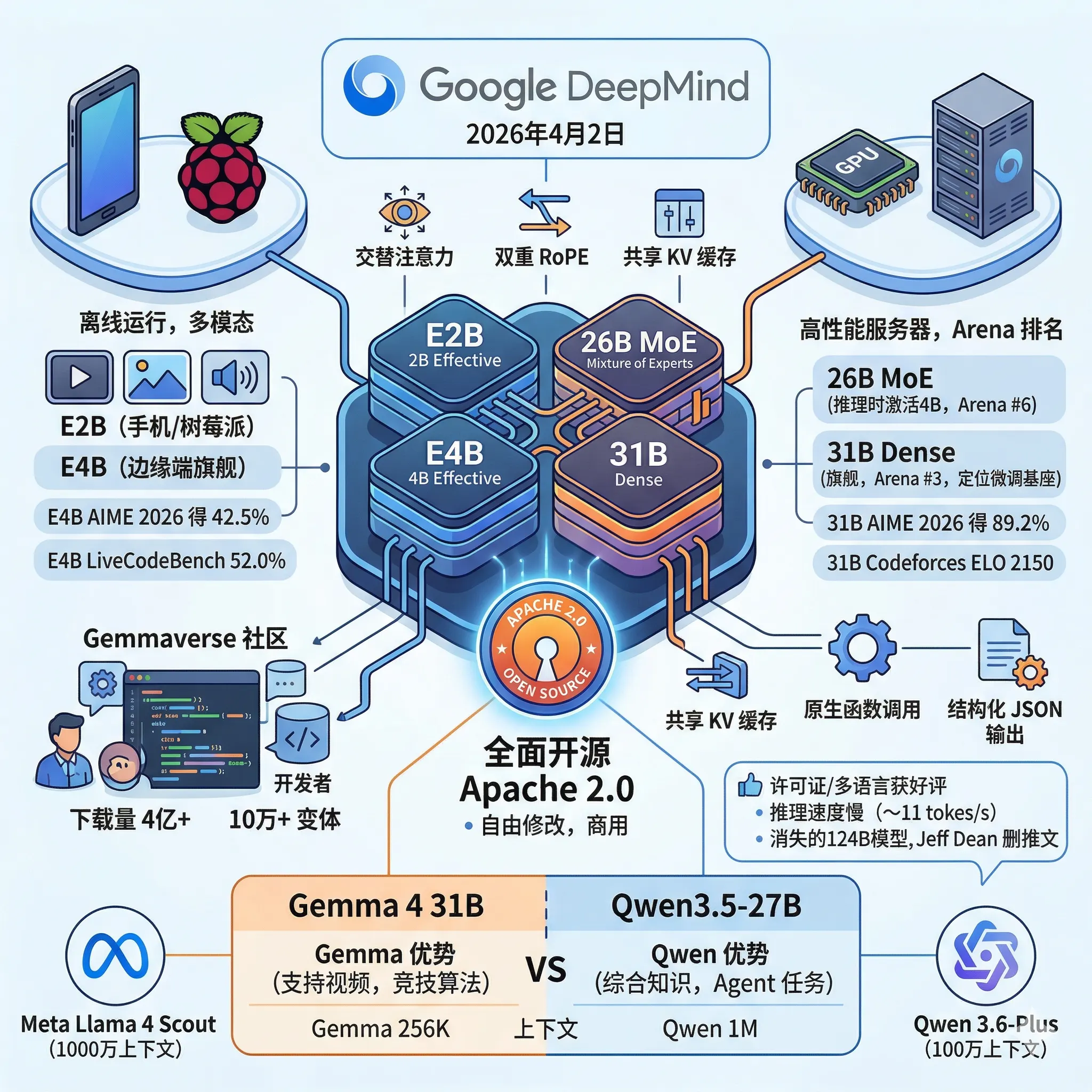

2026年4月2日,Google DeepMind 正式发布了 Gemma 4 系列模型。自2024年首代 Gemma 发布以来,开发者已经累计下载超过4亿次,并在此基础上衍生出超过10万个变体版本,形成了所谓的"Gemmaverse"社区生态。这次的 Gemma 4,Google 不只是做了常规的性能升级,而是在许可证、模型架构和部署覆盖范围上同时迈出了一大步。

2026年4月2日,Google DeepMind 正式发布了 Gemma 4 系列模型。自2024年首代 Gemma 发布以来,开发者已经累计下载超过4亿次,并在此基础上衍生出超过10万个变体版本,形成了所谓的"Gemmaverse"社区生态。这次的 Gemma 4,Google 不只是做了常规的性能升级,而是在许可证、模型架构和部署覆盖范围上同时迈出了一大步。

欢迎关注 DataLearner 官方微信,获得最新 AI 技术推送

Gemma 4 系列共包含四个模型,参数量从20亿到310亿,全部以 Apache 2.0 协议开源发布,支持图像、音频输入和140多种语言。

这是 Gemma 系列第一次以标准开源协议发布。之前的 Gemma 版本虽然开放权重,但使用的是 Google 自定义的专有许可证,用户无法自由修改和商业分发。Apache 2.0 协议则允许用户下载、修改和商业使用,只需保留适当的版权声明。

Gemma 4 基于 Gemini 3 相同的研究和技术构建,是目前可以在本地硬件上运行的性能最强的 Google 开放模型系列。这四个模型被划分为两个部署层次:针对手机、树莓派等边缘设备的轻量级系列(E2B、E4B),以及面向消费级 GPU 和高性能服务器的大规模系列(26B MoE、31B Dense)。

E2B 的推理时有效参数量为20亿,设计目标是在手机、树莓派和 NVIDIA Jetson Orin Nano 上以接近零延迟运行,可以完全离线使用。这个规模的模型做到多模态本身就不容易,E2B 支持128K的上下文窗口。

E2B 的"有效参数"概念值得解释一下。E2B 标注为"Effective 2B",意思是推理时激活的参数量是23亿,但模型总参数量实际为51亿,因为每个解码器层都携带一套额外的嵌入信号(Per-Layer Embeddings)。

E4B 的定位是边缘设备中的旗舰选项,有效参数量为40亿。这两款边缘模型原生支持视频、图像和音频处理,可用于语音识别和图像理解等任务。

E4B 在 AIME 2026 数学推理测试上达到42.5%,在 LiveCodeBench 上达到52.0%——这对一个可以在 T4 GPU 上运行的模型来说相当可观。更值得注意的是,E4B 在大多数 benchmark 上显著超越了没有推理模式的 Gemma 3 27B,参数量却只是后者的零头。

26B MoE 是混合专家架构(Mixture of Experts),总参数量260亿,但推理时只激活约40亿参数。它支持256K的上下文窗口,目前在 Arena AI 文本排行榜上位列开放模型第6名。

MoE 模型的 benchmark 表现与 Dense 版本非常接近:AIME 2026 得分88.3%,LiveCodeBench 77.1%,GPQA Diamond(研究生水平科学推理)82.3%。考虑到推理成本优势,这个差距相当小。

31B Dense 是 Gemma 4 中的旗舰模型,目前在 Arena AI 文本排行榜上位列全球开放模型第3名。

31B 在 AIME 2026 上达到89.2%,LiveCodeBench v6 达到80.0%,Codeforces ELO 为2150,视觉任务上 MMMU Pro 为76.9%、MATH-Vision 为85.6%。Google 把这个版本定位为微调基座,更适合企业做领域专属微调,而非日常直接调用。在 Apache 2.0 协议下,你可以用私有数据微调这个模型,商业部署衍生版本,无需事先取得 Google 的许可。

Gemma 4 引入了几个值得关注的架构设计:交替注意力机制——解码器层在局部滑动窗口注意力(处理512-1024个 token)和全局全上下文注意力之间交替,兼顾效率与长程理解;双重 RoPE——滑动窗口层用标准旋转位置编码,全局层用比例 RoPE,使大模型在不损失质量的情况下支持256K超长上下文;共享 KV 缓存——后几层复用前层的 KV 张量,大幅降低推理内存占用和计算开销。

函数调用(Function Calling)、结构化 JSON 输出和系统提示(System Prompt)在四个模型中均原生支持,不是事后通过指令跟随实现的。这对构建智能体(Agent)工作流的开发者意义很大——模型天生就知道怎么用工具。

在30B参数量级,目前公认最具代表性的两个开源模型是 Google 的 Gemma 4 31B 和阿里的 Qwen3.5-27B。两者都采用 Apache 2.0 协议、都支持思考模式、都可以免费商用,属于同一赛道的直接竞争对手。DataLearner 的横向评测对比页面汇总了目前可获取的公开 benchmark 数据,以下是主要发现。

综合知识和科学推理方面,Qwen3.5-27B 略占上风。 MMLU Pro 上 Qwen 得 86.1%,Gemma 得 85.2%;GPQA Diamond(博士级物理、化学、生物推理)上 Qwen 85.5%,Gemma 84.3%。差距不到1.5个百分点,但两个方向一致,Qwen 在综合学科知识上稳定高一点。

编程能力则是典型的各有所长。 LiveCodeBench v6 两者基本持平,Qwen 80.7%、Gemma 80.0%。但如果细分场景,差异就明显了:Codeforces ELO 这个衡量算法竞赛编程的指标上,Gemma 4 31B 得 2150,Qwen3.5-27B 得 1899,相差251分,在这个分段里差距非常显著,Gemma 在竞赛类算法题上明显更强。另一边,SWE-bench Verified 测的是在真实代码库中定位和修复 bug 的能力,Qwen 得 72.4%,Gemma 没有公布对应数据,这个工程实战维度目前无法比较。

在 Agent 任务和工具调用上,Qwen3.5-27B 有优势。 τ²-Bench(多步 Agent 任务执行)Qwen 得 79.0,Gemma 得 76.9。更值得注意的是 HLE(人类最难问题评测):不使用工具的纯推理条件下,Gemma 4 31B 得 26.5%,比 Qwen 的 24.3% 略高;但一旦允许使用工具,Qwen3.5-27B 直接跳到 48.5%,提升幅度远超 Gemma——Gemma 在有工具条件下的 HLE 分数没有公布,但这个反差本身说明了一些问题。

指令遵循和多语言,Qwen 有完整数据,Gemma 没有。 IFEval(指令遵循精确度)Qwen 得 95.0%,接近满分,Gemma 没有发布该项数据。多语言评测上,Qwen 在跨语言 MMMLU 得 85.9%、覆盖29种语言的 MMLU-ProX 得 82.2%,Gemma 虽然声称支持140+种语言,但目前没有任何多语言 benchmark 数据公布,是一个明显的信息空白。

多模态是 Gemma 4 31B 明确的差异化方向。 MMMU Pro 综合多模态理解上 Gemma 得 76.9%,Qwen 没有发布对应分数。更关键的是:Gemma 4 31B 支持最长60秒的视频序列输入,Qwen3.5-27B 不支持视频。如果应用场景涉及视频理解,这是目前这个参数量级里 Gemma 独有的能力。

人类偏好评分上,Gemma 排名更靠前。 Gemma 4 31B 在 LMArena 文本对话榜的预估 ELO 约为 1452,开放模型中排第三。Qwen3.5-27B 没有公布对应的 Arena 排名数据。

总体来看,两者的差距并没有 benchmark 数字有时呈现的那么悬殊。Qwen3.5-27B 在纯文本任务上更全面稳定——综合知识、科学推理、指令遵循、工具调用均有具体数据支撑,而且上下文窗口长达100万 token,是 Gemma 256K 的约四倍。Gemma 4 31B 的优势集中在两个方向:一是多模态(尤其是视频输入),二是竞赛类算法编程,另外在人类偏好评分上表现更好。如果任务场景不涉及视频或算法竞赛题型,从目前公开的数据来看,Qwen3.5-27B 是更保险的选择;反之,Gemma 4 31B 的视频能力和更高的 Arena 分数值得认真考量。

Gemma 4 的真正突破,比 benchmark 数字更重要的,是许可证的切换。

过去两年,企业在评估 Gemma 系列时面临一个尴尬的两难困境:Google 的自定义许可证包含各种使用限制和随时可能修改的条款,把很多团队推向了 Mistral 或阿里的 Qwen。法律审查带来的摩擦、合规团队标记的边缘情形,让"开放但有星号"的 Gemma 3 无法真正进入生产环境。

Gemma 4 彻底消除了这种摩擦。Apache 2.0 协议与 Qwen、Mistral 以及大多数开放权重生态系统使用的条款完全一致,没有自定义条款,没有需要法律解读的"有害使用"排除条款,没有对再分发或商业部署的限制。

时间节点也耐人寻味。就在一些中国 AI 实验室(比如阿里最新的 Qwen 旗舰模型)开始从完全开放向专有方向收缩的时候,Google 正在反向操作——用最强的 Gemma 版本转向更彻底的开放。

从覆盖范围来看,Gemma 4 让开发者同时拥有行业最强大的开放和专有工具组合——Gemini 系列处理企业级需求,Gemma 4 承担本地私有部署、敏感行业合规场景和开发者实验。这种双轨战略是 Google 相对 Meta(Llama 4 还保留了用户规模门槛限制)更有吸引力的地方。

发布后24小时内,开发者社区迅速展开了压测,评价呈现出明确的分层。

最受认可的是许可证和多语言能力。 Apache 2.0 被普遍认为是这次发布中比 benchmark 数字更重要的变化。测试德语、阿拉伯语、越南语和法语的用户报告称 Gemma 4 在非英语任务上超越了 Qwen 3.5,有人称其在翻译方面是"独占一档"。

Hugging Face 团队给出了高度评价。 他们表示在预发布版本测试中印象深刻,甚至因为模型开箱即用的质量太高,难以找到足够有代表性的微调示例。

但速度问题成为发布后最集中的抱怨。 26B MoE 模型本应是效率优先的选择,但社区测试显示其实际推理速度只有约11 tokens/秒,而 Qwen 3.5 在同等 GPU 上能达到60 tokens/秒以上。这对于生产场景来说差距过于明显。

产品线的空白也引发了讨论,尤其是那个消失的124B模型。 发布当天,Google 的 Jeff Dean 在 X 上发的推文里写道 Gemma 4 的规模覆盖从边缘端"up to a 124B parameter MoE model"——但这句话不久后就从推文中悄悄删除了。社区很快注意到这个细节,结合发布前 Arena 上曾出现过一个叫"significant-otter"的匿名模型(自称是 Gemma 4,当时曝光的产品线包含一个 120B-A15B 的 MoE 版本),外界普遍认为更大规模的 Gemma 4 确实存在,只是没有随四款模型一起发布。有猜测认为这个模型在某些 benchmark 上的表现已经超越了 Gemini 3 Flash-Lite,Google 因此暂时搁置了发布。E4B 和 26B MoE 之间缺少一个12B左右的中间档位,也是另一个被反复提到的遗憾——Gemma 3 12B 在社区里颇受欢迎,但 Gemma 4 没有直接对应的升级版本。

整体判断倾向于"值得关注,但还不够成熟"。 2026年4月是开源 AI 史上最拥挤的一个月:阿里在同一天发布了支持100万 token 上下文的 Qwen 3.6-Plus,Meta 的 Llama 4 Scout 已经支持1000万 token 上下文。Gemma 4 进入的是一场激烈竞争,而不是一场加冕典礼。从务实角度来看:对于纯英文、速度敏感型场景,Qwen 3.5 目前仍是更优选择;对于多语言、有商业合规需求、以微调为主要使用方式的场景,Gemma 4 有相当有力的理由。速度和工具链的问题还需要几周时间沉淀,等量化感知训练(QAT)版本出来后,小规模模型的效率表现也会有明显改善。

把时间线拉长来看,这次发布的意义或许不只在于 Gemma 4 本身的性能。一个真正以 Apache 2.0 开放的、覆盖从树莓派到高性能 GPU 全场景的 Google 模型系列,改变的是开发者的选项格局——至少在许可证层面,Google 终于和开源社区站在了同一边。而那个还没有出现的124B大模型,或许才是下一个值得期待的故事。