如何用7.7亿参数的蒸馏模型超过5400亿的大语言模型——Google提出新的模型蒸馏方法:逐步蒸馏(Distilling step-by-step)详解

1750亿参数规模的模型需要350G的GPU显存才能做推理,显然,这样大规模的模型在实际应用中压力会很高。对于大多数产品或者团队来说,这都是一个难以负担的成本。

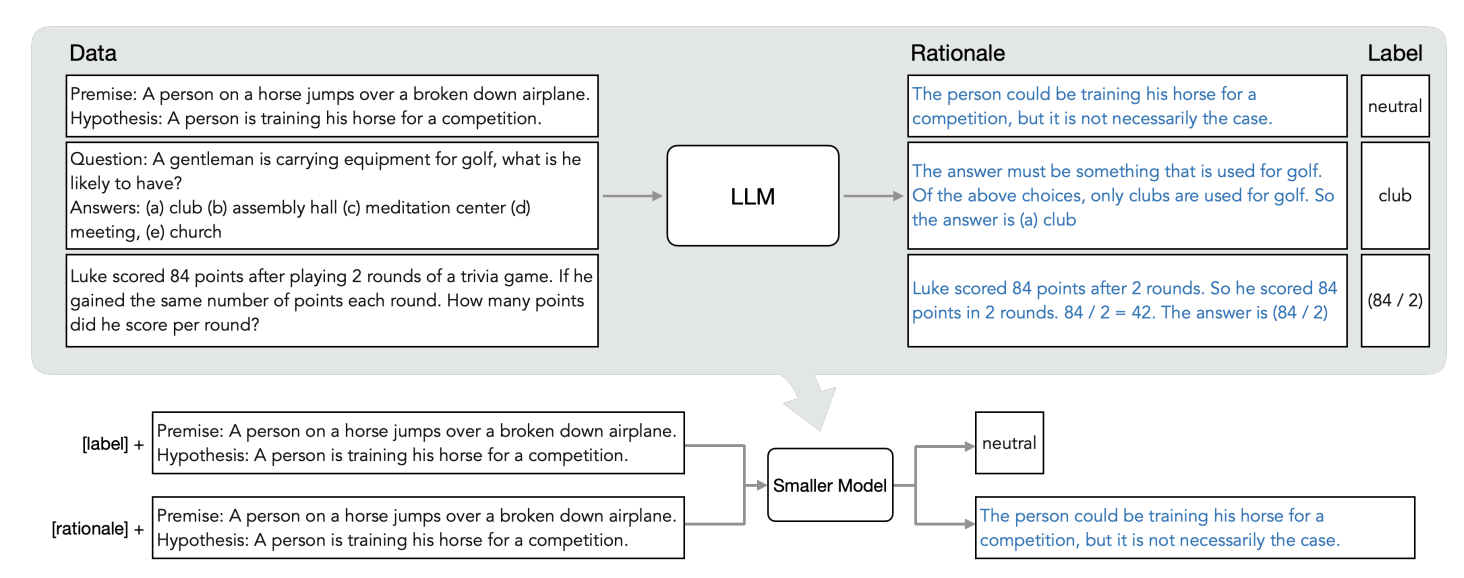

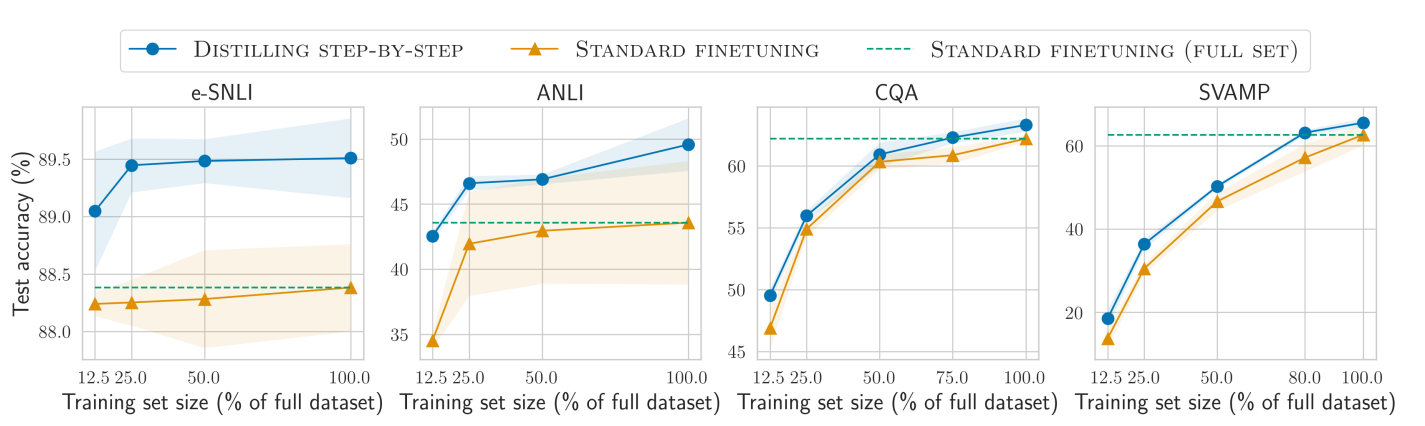

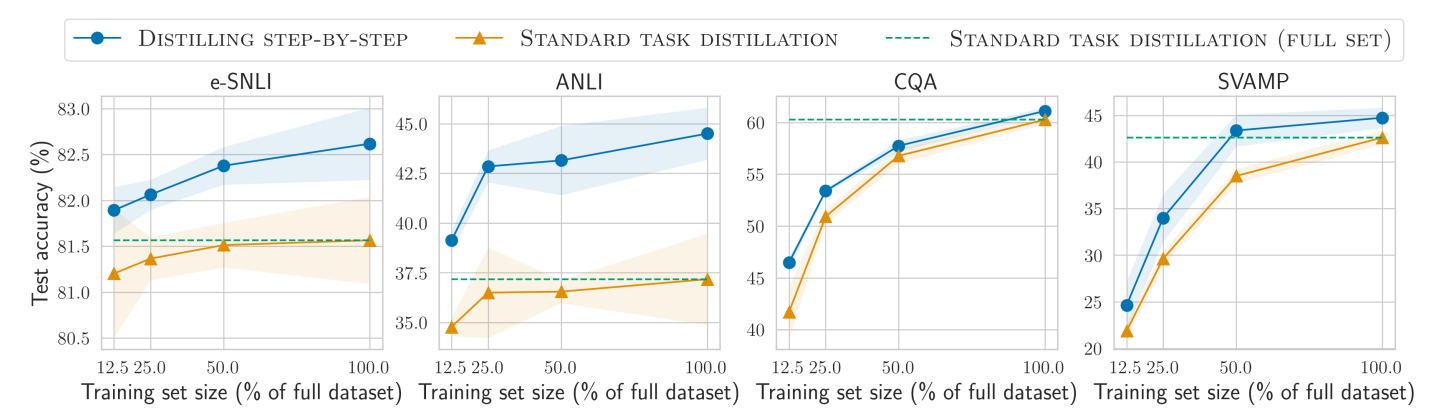

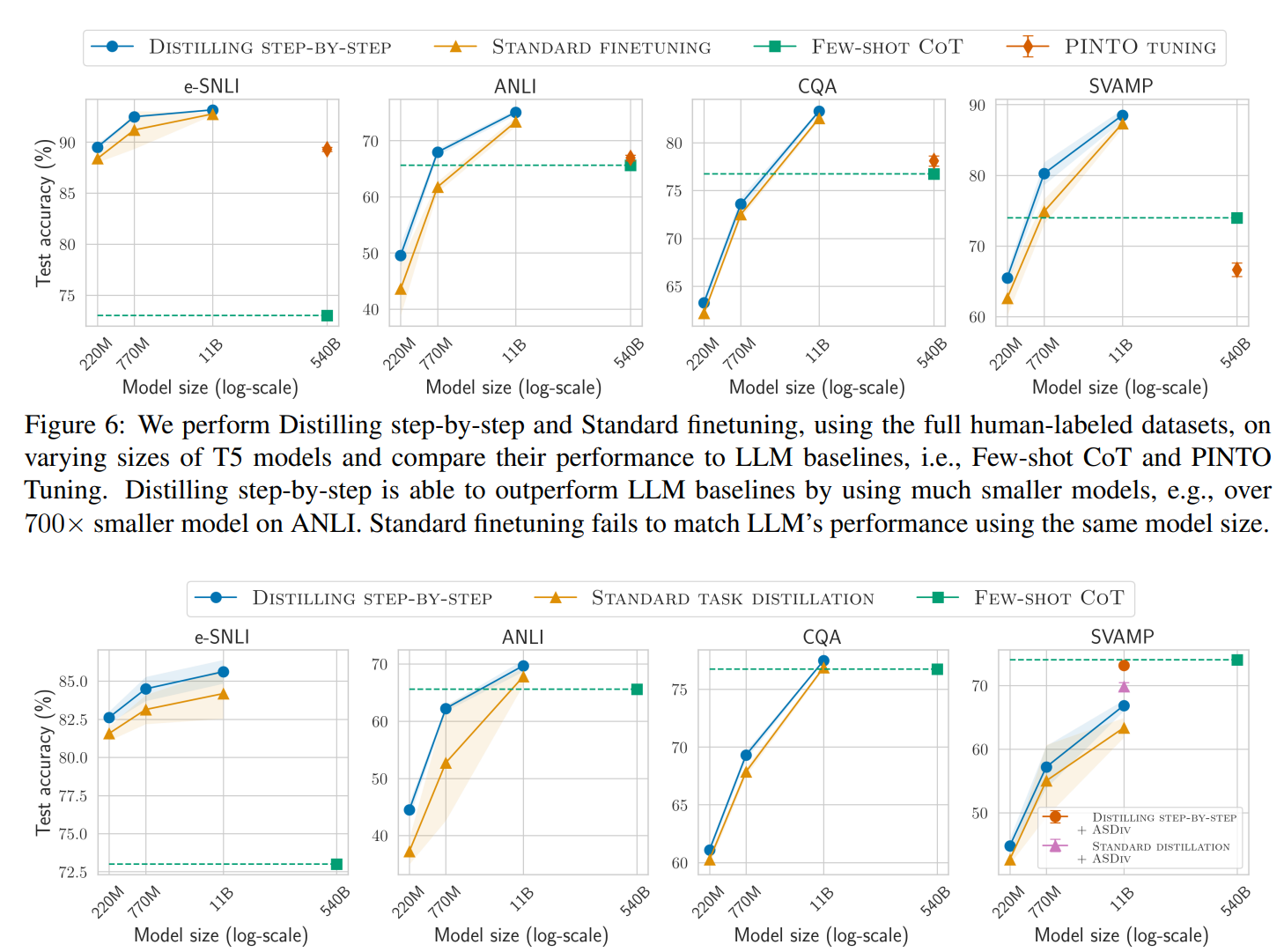

为此,华盛顿大学研究人员与Google的研究人员一起在5月3日公布了一个新的方法,即逐步蒸馏(Distilling step-by-step)法,这个方法最大的特点有2个:一是需要更少的数据来做模型的蒸馏(根据论文描述,平均只需要之前方法的一半数据,最好的情况只需要15%的数据就可以达到类似的效果);二是可以获得更小规模的模型(最多可以比原来模型规模小2000倍!即可获得大模型差不多的效果)。

需要注意的是,逐步蒸馏(Distilling step-by-step)方法可以应用在所有类型的语言模型中,没有限制!这个方法应该是非常有价值的,对于未来我们做模型小型化有很大的帮助,也在推特上吸引了很多的讨论。本文将详细解释一下这个方法的核心思想。

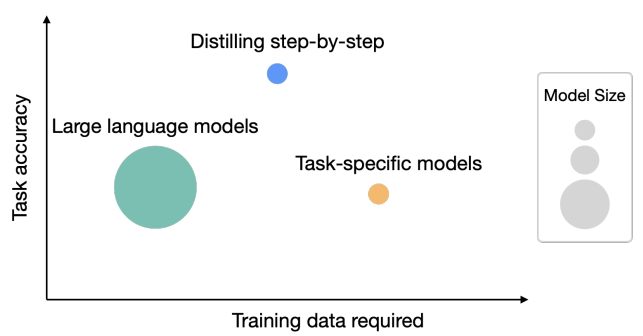

下图是一个简单的示意图,可以看到逐步蒸馏法的优势:

本文将从如下几个方面介绍这个方法。